Mais sofisticados, robôs são considerados novas ameaças às eleições brasileiras

Cada vez difícil de identificar, ação dos bots induz o compartilhamento de informações falsas e polariza discursos

Marcos de Paula/Estadão - 24/10/2014

Marcos de Paula/Estadão - 24/10/2014

Durante a greve geral em abril deste ano, uma em cada cinco interações no Twitter favoráveis à paralisação pode ter partido de robôs. Suspeitas semelhantes foram registradas nas eleições de 2014 e durante as manifestações pró e contra o impeachment de Dilma Rousseff (PT). Criados para fazer postagens automáticas nas redes sociais, os bots se tornaram mais sofisticados, a ponto de agir como humanos, dificultando sua identificação. Segundo especialistas, o uso dessas contas deve ser maior nas eleições do ano que vem.

“Certamente os robôs vão estar mais presentes e mais infiltrados em 2018”, diz o professor de Ciências da Computação Fabrício Benevenuto, da Universidade Federal de Minas Gerais (UFMG). Também acredita nisso o norte-americano Daniel Arnaudo, pesquisador de cibersegurança da Universidade de Washington (EUA) e membro do Oxford Internet Institute. “Mais eleitores usam as redes sociais para se informar e tais estratégias estão crescendo em escala e sofisticação”, afirma Arnaudo. “Os bots são programados para compartilhar qualquer conteúdo. Verdadeiro ou falso, esse material é criado para induzir o compartilhamento e incentivar discursos ainda mais polarizados e extremos.”

O fenômeno do uso de bots para influenciar decisões importantes é mundial — um exemplo recente é a suspeita da ação de robôs russos durante o processo eleitoral nos Estados Unidos. Além disso, os especialistas apontam para esse risco na próxima eleição brasileira devido ao que observaram em momentos políticos marcantes no País nos últimos anos. Onze por cento da discussão no Twitter durante um debate entre a então presidente Dilma e o senador Aécio Neves (PSDB), por exemplo, podem ter partido de robôs, segundo levantamento da Diretoria de Análise de Políticas Públicas da Fundação Getulio Vargas (FGV/DAPP). O mesmo percentual foi observado nas interações durante as manifestações pró e contra o impeachment.

“É o uso de um recurso ilegítimo para interferir e manipular o debate, distorcendo a discussão sobre temas relevantes”, diz o pesquisador Amaro Grassi, da FGV, um dos responsáveis pela pesquisa. “Nos campos em que se situam, essas contas estão em posição de mais conflito e combate e favorecem a polarização do debate público.” Neste ano, de acordo com a pesquisa da FGV/DAPP, mais de 20% das postagens a favor da greve geral podem ter sido produzidas por robôs.

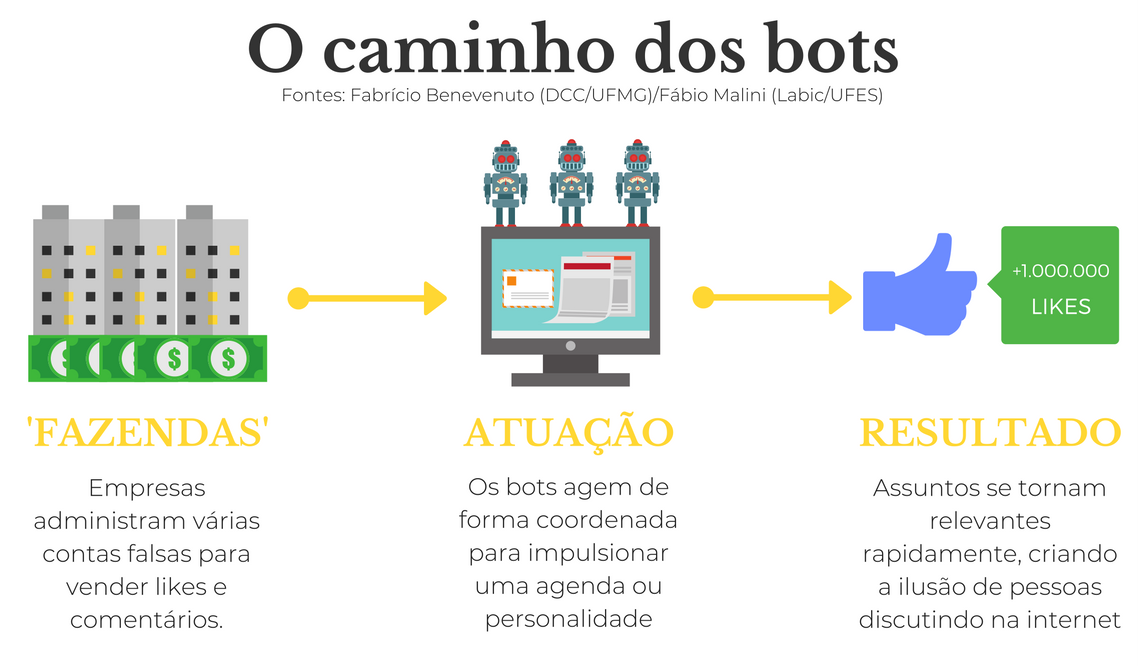

Sem filtros para barrá-las, empresas especializadas têm caminho aberto para impulsionar candidaturas e influenciar a opinião pública. “Quando os bots chegam à política, empresas oferecem a contratação de pessoas para administrar várias contas falsas que vão publicar material a favor de um candidato ou contra o adversário”, diz o professor Fábio Malini, coordenador do Laboratório de Estudos sobre Imagem e Cibercultura (Labic) da Universidade Federal do Espírito Santo. “Seja à esquerda ou à direita, os bots tentam silenciar os críticos e desviar a atenção de determinado tema.”

Desafio da identificação

Diferentemente das contas que publicam spam e são rapidamente detectadas, os robôs mais desenvolvidos burlam os filtros ao simular padrões humanos. Alguns são programados para “dormir” oito horas por dia e postar mensagens sobre assuntos variados em horários aleatórios, além de interagir com outros usuários e entre si, criando redes para impulsionar os próprios conteúdos.

“Na maior parte do tempo, essas contas se comportam como um ser humano normal”, diz Benevenuto. “Mas, durante as eleições, as empresas por trás dessas contas fazem elas agirem de forma coordenada e agressiva.” Segundo ele, por serem tão similares ao comportamento humano, as redes sociais não se arriscam a suspender os robôs por receio de banir uma pessoa real. “Para os filtros, a impressão que esses robôs passam nas eleições é que são apenas usuários engajados. Esse é o disfarce.”

Conhecidos como ciborgues virtuais pelos especialistas, os robôs mais sofisticados atuam nas áreas mais polarizadas dos debates políticos, produzindo e replicando conteúdo para inflamar ainda mais a discussão. O objetivo não é apenas minimizar a resposta da oposição, como também despistar os filtros de detecção.

“Quando os bots aumentam a ‘temperatura’ do debate, as pessoas tendem a publicar mais e tomar atitudes sem pensar. Com isso, os radares das redes sociais dão uma relaxada na fiscalização”, explica Fábio Malini. “É nesse vácuo que entram as notícias falsas, os boatos e a desinformação.”

Problema mundial

O problema não é restrito ao Brasil. Nos Estados Unidos, o FBI investiga a ação de robôs russos na divulgação de conteúdos falsos contra a candidata democrata Hillary Clinton. O objetivo das contas, segundo as investigações, seria influenciar o resultado das eleições que elegeram o empresário republicano Donald Trump.

Na Europa, ação semelhante de desinformação movida por bots foi identificada nas vésperas da eleição francesa, quando a hashtag #MacronLeaks subiu rapidamente no Twitter para denunciar um suposto vazamento de informações prejudiciais contra o candidato Emmanuel Macron. Na Alemanha, existe a suspeita de que a ascensão do partido de extrema-direita Alternativa para a Alemanha (AfD) foi impulsionada por robôs.

Renata Giannini/Instituto Igarapé

Segundo Daniel Arnaudo, pesquisador de cibersegurança da Universidade de Washington, as constantes interferências nos debates públicos em todo o mundo colocam a democracia em risco. “Existe uma grande vulnerabilidade nos sistemas democráticos atuais”, diz. “Governos, partidos políticos, imprensa e eleitores estão mal preparados para responder a esse tipo de campanha. Além disso, as leis evitam regular o conteúdo político online e isso cria brechas que podem ser aproveitadas pelos candidatos.”

Segundo o pesquisador, a falta de iniciativa dos partidos em denunciar os robôs e a dificuldade da imprensa em desmascará-los acabam por abrir espaço para a atuação dessas contas falsas. “Infelizmente, os eleitores comuns ainda carecem de fontes de referência para ajudá-los a navegar pelas redes sociais e outros sistemas de informação online que podem ser facilmente manipuláveis.”

Detecção de robôs

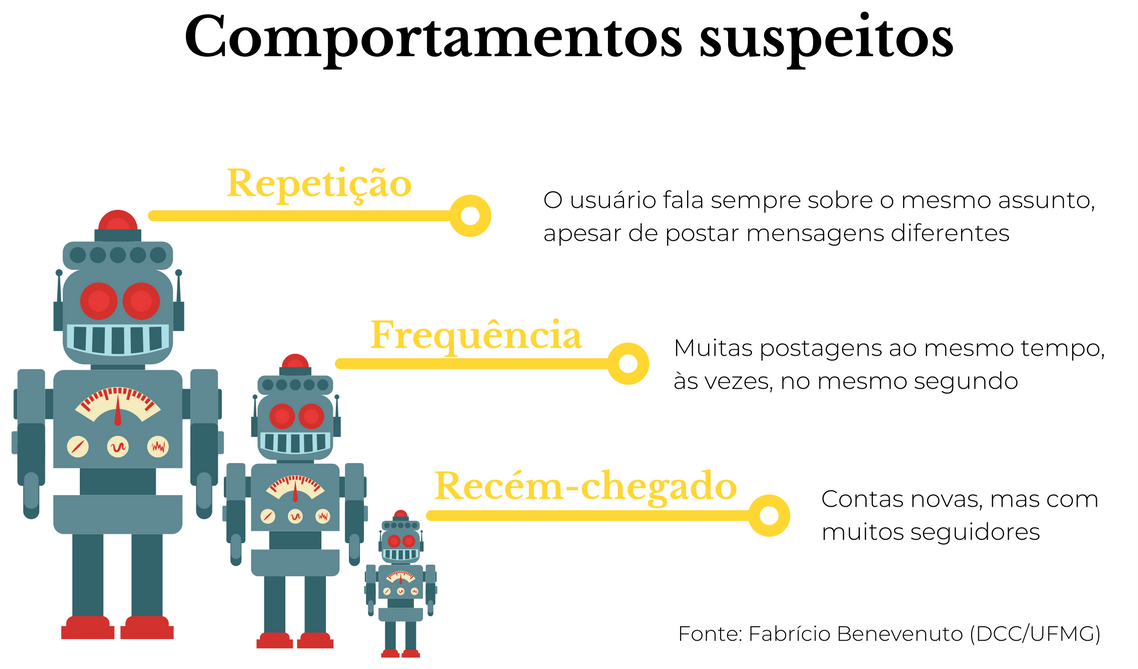

Apesar da dificuldade em diferenciar bots de usuários reais, alguns comportamentos dentro das redes podem levantar suspeitas. Os robôs mais simples, de acordo com Benevenuto, da UFMG, apresentam traços automatizados em suas postagens. “Eles postam sempre sobre o mesmo assunto e com uma frequência muito alta, que nenhum humano daria conta”, afirma.

Identificar as contas falsas é, segundo o professor de Ciências da Computação, praticamente um jogo de gato e rato, em que nunca se pode ter certeza sobre as ações de determinado perfil. “Só se pode comprovar que não é um robô se você for na casa da pessoa e verificar que tem alguém lá”, diz Benevenuto.

Algumas aplicações, no entanto, tentam facilitar a vida do usuário do Twitter a detectar os robôs. É o caso do Botometer, um projeto elaborado conjuntamente pelo Instituto de Ciências da Computação da Universidade de Indiana (IUNI) e pelo Centro de Computação Complexa e Mecanismos de Busca (CNetS). Na plataforma, ao inserir o nome de determinado perfil, o programa reproduz uma relação de seus seguidores, classificando-os pela chance de as contas serem bots.

Para realizar o ranqueamento das contas mais prováveis de serem robôs, o Botometer leva em consideração quatro fatores: o conteúdo das postagens, que avalia o vocabulário do que foi escrito; o sentimento das mensagens, por meio do qual é avaliada a polaridade do que foi escrito (negativo, neutro ou positivo); a qualidade das conexões entre os seguidores, verificando se há muitas contas automáticas ligadas ao perfil analisado; e a permanência na rede social, que verifica por quanto tempo o perfil fica conectado.

Colaborou Jéssica Díez Corrêa